22. Debiasing Word Embeddings

2023. 9. 27. 16:18ㆍGoogle ML Bootcamp/5. Sequence Models

어떻게 해결할까?

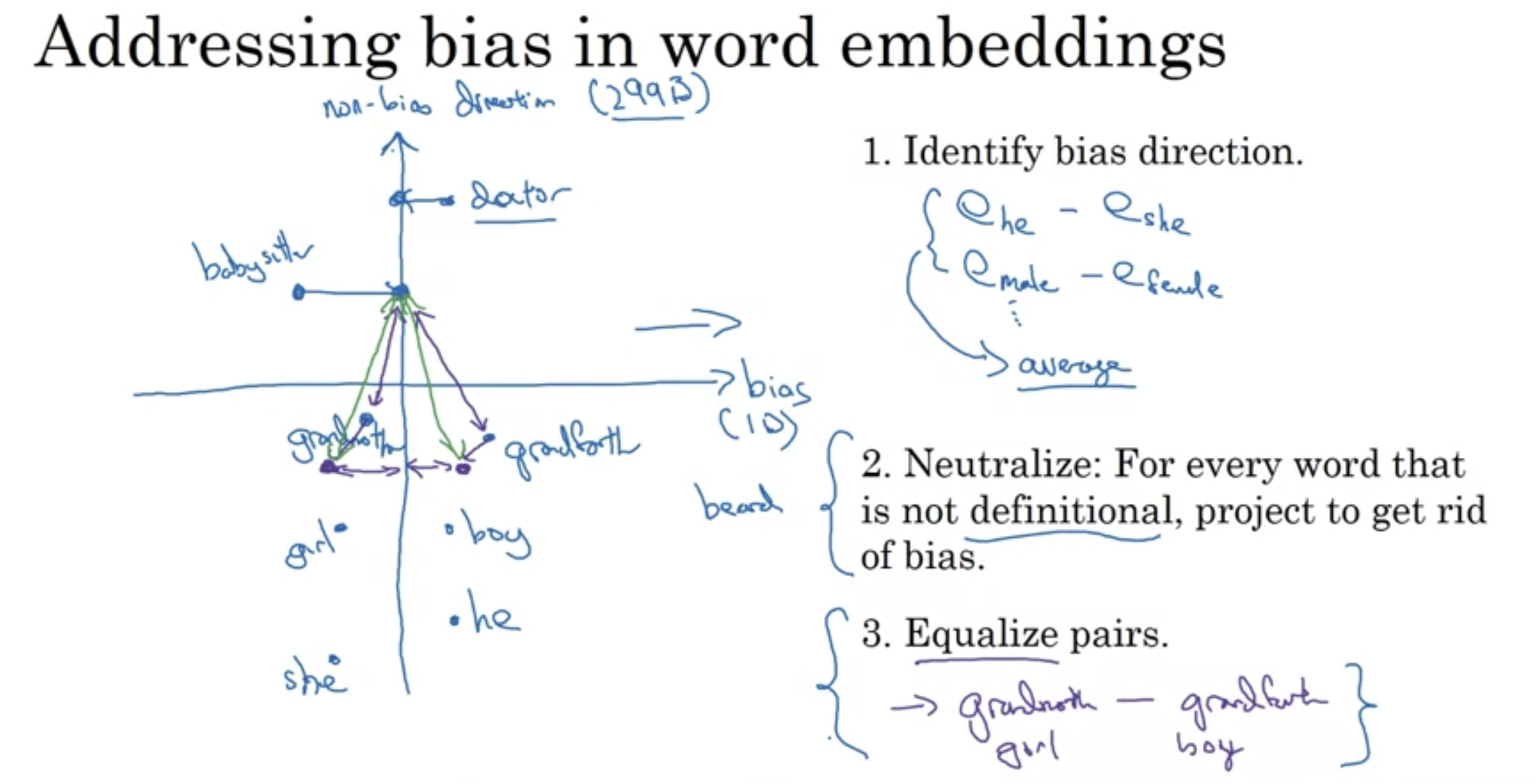

1. 찾고자 하는 bias에 대해 방향성을 파악한다.

2. 모든 word에 대해서 정의를 살펴보고, bias를 제거한다

- 예를 들면 할머니, 할아버지에는 gender feature로 정의될 수 있지만 doctor의 경우 gender feature의 영향은 제거되길 원한다.

3. 평준화 진행.

- doctor와 man, doctor와 woman의 거리는 같아야한다. 그래야 gender feature에 대해 영향을 같은 수준으로 받기 때문.

- 거리가 같아야한다는거지 같은 위치에 자리해야한다는건 아님.

'Google ML Bootcamp > 5. Sequence Models' 카테고리의 다른 글

| 24. Picking the Most Likely Sentence (0) | 2023.10.22 |

|---|---|

| 23. Basci Models (0) | 2023.10.22 |

| 21. Sentiment Classification (0) | 2023.09.27 |

| 20. GloVe Word Vectors (0) | 2023.09.27 |

| 19. Negative Sampling (0) | 2023.09.27 |